Краткое саммари

Битые ссылки ведут на несуществующие страницы, обычно из-за удаления контента, смены URL без редиректа, технических ошибок или опечаток. Они ухудшают пользовательский опыт, повышают отказы и мешают передаче ссылочного веса, хотя обычные 404 не считаются проблемой для краулингового бюджета, в отличие от soft 404.

Искать такие ссылки можно через Google Search Console, Яндекс.Вебмастер, краулеры и специальные сервисы. Исправлять их нужно в зависимости от ситуации: заменять или удалять ссылки, восстанавливать страницы, ставить 301-редиректы, а для удаленных URL настраивать корректные ответы 404/410 и удобную страницу ошибки 404.

Кому стоит прочитать эту статью:

SEO-специалистам — чтобы находить и устранять битые ссылки, которые ухудшают перелинковку, пользовательский опыт и качество технической оптимизации сайта.

Владельцам сайтов — чтобы понимать, почему посетители могут попадать на несуществующие страницы и как это влияет на доверие, конверсии и удержание аудитории.

Интернет-маркетологам — чтобы не терять трафик из-за технических ошибок и поддерживать посадочные страницы и ссылки в рабочем состоянии.

Контент-менеджерам и редакторам — чтобы проверять ссылки в статьях, карточках товаров и меню, не отправляя пользователей на 404-страницы.

Веб-мастерам и администраторам сайтов — чтобы правильно настраивать 301-редиректы, ответы 404/410 и устранять причины появления битых URL.

Разработчикам — чтобы учитывать последствия смены URL, переезда на HTTPS, ошибок маршрутизации и других технических изменений на сайте.

Пользователям WordPress и других CMS — чтобы выбрать подходящие плагины, сервисы и краулеры для автоматической проверки ссылок.

Представим, что на сайте опубликовали статью и поставили ссылку на источник — Википедию. Страницу Википедии удалили, владелец сайта об этом не знает, ссылка в статье все еще стоит, но теперь ведет на страницу 404.

Еще пример: в интернет-магазине товар переместили в новую категорию или настроили ЧПУ, но не сделали редиректы со старых URL. Теперь старые ссылки на товары ведут на несуществующие страницы.

Эти ссылки называют битыми, по таким ссылкам пользователь никуда не попадет.

Что такое битые ссылки?

Битые ссылки — это гиперссылки, которые ведут на несуществующие файлы или страницы ресурса. Они могут быть внутренними — в рамках одного сайта, или внешними — на страницы стороннего ресурса.

Страницы отдают серверу код ответа 404 Not Found — он означает, что сам сервер найден, но документа по такому адресу не существует, имя файла в коде и на сервере не совпадает. К примеру, файл на сервере удалили или переместили, и теперь он доступен по новому адресу. То же самое может произойти, если в URL есть ошибка.

FAQ по разделу

Всегда ли битая ссылка — это ошибка 404?

Чаще всего да, но не только. Битые ссылки могут вести и на другие недоступные страницы с кодами 4xx или 5xx. Однако в SEO и веб-аналитике под ними обычно имеют в виду именно ссылки на 404-страницы.

Чем битая ссылка отличается от удаленной страницы?

Битая ссылка — это сам нерабочий переход, а удаленная страница — причина проблемы. То есть страница могла исчезнуть, а ссылка на нее осталась в меню, тексте или карточке товара.

Откуда берутся битые ссылки?

Они могут появится по техническим причинам, при изменении структуры сайта или по ошибке пользователя. Вот самые распространенные причины:

Удаление страницы или контента

Если удалили страницу с устаревшим контентом или по ошибке удалили актуальную, ссылка на нее останется, но работать не будет;

Изменение URL без настройки 301 редиректа

Изменения в URL могут привести к битым ссылкам. Это может произойти при обновлении структуры сайта, смене родительского раздела или при попытке оптимизации URL;

Изменение ассортимента интернет-магазина

Когда товары заканчиваются на складе и их страницы удаляют, нерабочие ссылки могут остаться;

Неверная настройка переезда на HTTPS-протокол

Если при переходе на HTTPS-протокол не настроили перенаправление с HTTP;

Технические ошибки на сайте или на стороне сервера

Ошибки в настройке веб-сервера, проблемы с ЧПУ, неправильное кэширование страниц;

Случайные ошибки и человеческий фактор

Например, если при внутренней перелинковке администратор сайта скопировал ссылку не полностью;

Устаревание перелинковки

Нужно регулярно проверять внутренние ссылки, чтобы все они вели на существующие страницы;

Специальный или случайный ввод в адресную строку браузера несуществующих адресов

Это может произойти, когда пользователи вручную вводят URL и делают опечатку.

FAQ по разделу

Может ли битая ссылка появиться после обновления структуры сайта?

Если разделы, категории или URL изменились, а старые адреса остались в меню, статьях или карточках товаров, ссылки начинают вести на несуществующие страницы.

Опасно ли удалять страницы интернет-магазина без редиректа?

Если удалить карточку товара и не перенаправить пользователей на аналогичный товар, категорию или замену, старые ссылки станут битыми.

Чем вредны битые ссылки на сайте

Санкций от поисковых систем за неработающие ссылки нет, но они портят пользователям впечатление от сайта и увеличивают отказы.

Ухудшение поведенческих факторов

Пользователь надеялся получить дополнительную информацию, а по ссылке ошибка — ожидания не оправдались. Если он попал на страницу 404, он может закрыть вкладку с сайтом и пойти к конкурентам.

Проблемы с передачей ссылочного веса

Такие ссылки вредят внутренней перелинковке и ссылочной массе сайта в целом — через нерабочую ссылку не передается вес ни со своего сайта, ни с чужих.

Уменьшение краулингового бюджета, но на самом деле это миф

Есть мнение, что битые ссылки отрицательно влияют на краулинговый бюджет — ресурсы, которые ПС выделяет на сканирование сайта. Пишут, что краулер потратит лимиты на бесполезный обход битых ссылок и из-за этого проигнорирует важные страницы.

По словам Джона Мюллера, сотрудника Google, это не так: 4хх ошибки не приводят к снижению краулингового бюджета. Бот повторно сканирует эти страницы, чтобы убедиться, что они закрыты, но делает это не в ущерб остальным страницам.

Еще Джон Мюллер отмечает, что неважно, сколько страниц с ошибками 404 есть на сайте, сами по себе они не могут снизить рейтинг остальных страниц.

4хх ошибки не крадут бюджет краулера. Но это касается не всех страниц 4хх.

Ошибка 404 SOFT

В блоге Google перечисляют страницы, которые негативно влияют на распределение бюджета, и среди них есть «мягкие страницы ошибок», то есть 404 SOFT.

404 SOFT возникают, если для несуществующей страницы сервер должен ответить кодом 404 или 410, а вместо этого отвечает HTTP-кодом ответа 200 OK. В таком случае краулер воспринимает страницу как обычно, сканирует ее и тратит краулинговый бюджет вместо обхода действительно важных страниц. Ошибки 404 SOFT тратят краулинговый бюджет.

Большое количество страниц 404 точно не принесет никакого положительно эффекта, а навредить может, поэтому лучше их исправить. Найти страницы 404 помогут специальные сервисы и инструменты.

FAQ по разделу

Передается ли ссылочный вес через битую ссылку?

Нет, если ссылка ведет на несуществующую страницу, она не помогает передавать вес внутри сайта и не приносит пользы для ссылочной структуры.

Все ли 404-страницы тратят краулинговый бюджет?

Не совсем. По данным Google, обычные 404 сами по себе не вредят краулинговому бюджету. Но проблемой могут быть soft 404, когда несуществующая страница возвращает код 200 OK вместо 404 или 410.

Почему важно вовремя находить битые ссылки: два кейса

- Увеличение числа фишинговых атак. В 2024 году в России было зафиксировано значительное увеличение числа фишинговых атак, что привело к росту числа вредоносных ссылок.

Вывод: чтобы предотвратить попадание пользователей на потенциально опасные ресурсы, важно регулярно мониторить и устранять битые ссылки. - Ужесточение борьбы с пиратским контентом. В 2024 году российские медиахолдинги значительно увеличили количество запросов на блокировку ссылок на пиратские ресурсы, что привело к удалению миллионов ссылок из поисковых систем.

Вывод: чтобы избежать попадания на заблокированные или недоступные страницы, нужно своевременно обновлять и проверять ссылки на сайте.

Как искать битые ссылки

Для совсем небольших сайтов можно обойтись ручным способом — пролистать все страницы и посмотреть все ссылки на сайте или посмотреть ссылки из выдачи ПС по запросу «site: вашсайт.ру»

Сервисы могут показывать неточные результаты, так что комбинируйте несколько инструментов, чтобы найти как можно больше страниц с ошибками.

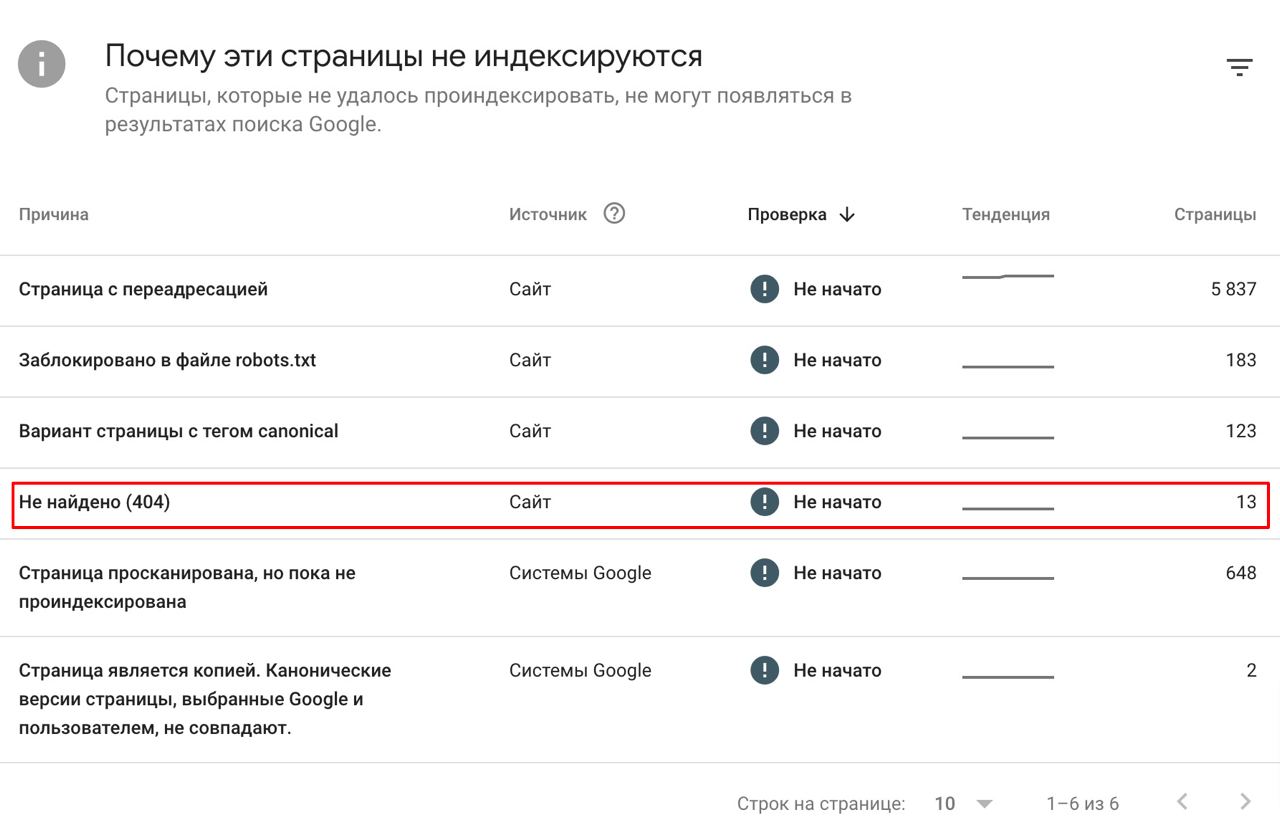

Google Search Console

Страницы с ошибками 404 Search Console отображает в разделе «Страницы». В таблице «Почему эти страницы не индексируются» перечислены причины и количество страниц с каждым типом проблемы. Если кликнуть по причине, можно увидеть список страниц.

В консоли перечислены ссылки на момент последнего обхода сайта краулером, поэтому в режиме реального времени отследить ссылки не получится.

Удобно отслеживать 404 ошибки можно с помощью Google Tag Manager. Как это сделать — в руководстве.

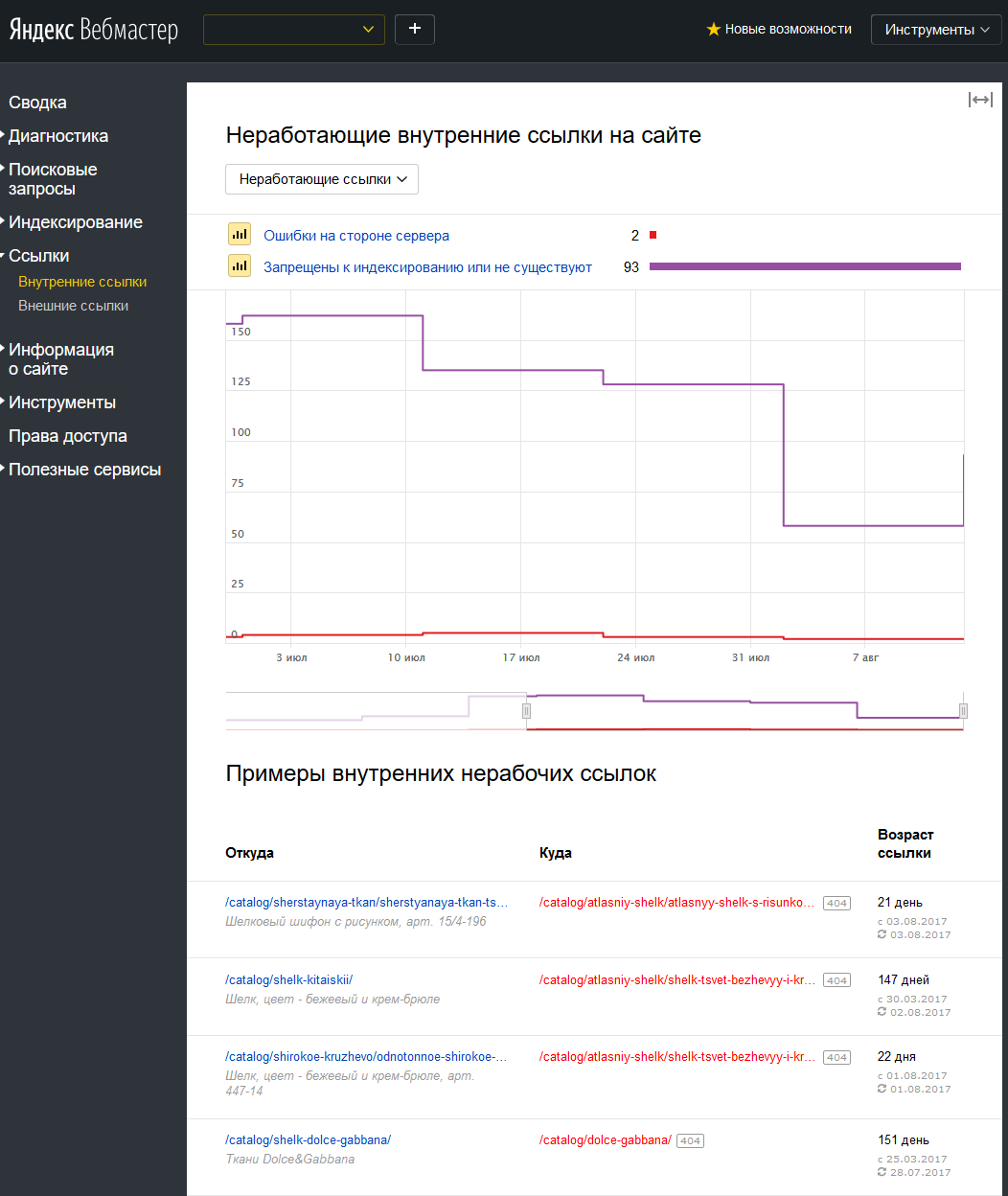

Яндекс.Вебмастер

Сервис отображает битые ссылки в разделе «Ссылки». Он покажет примеры внутренних неработающих ссылок по данным последнего обхода сайта ботом Яндекса.

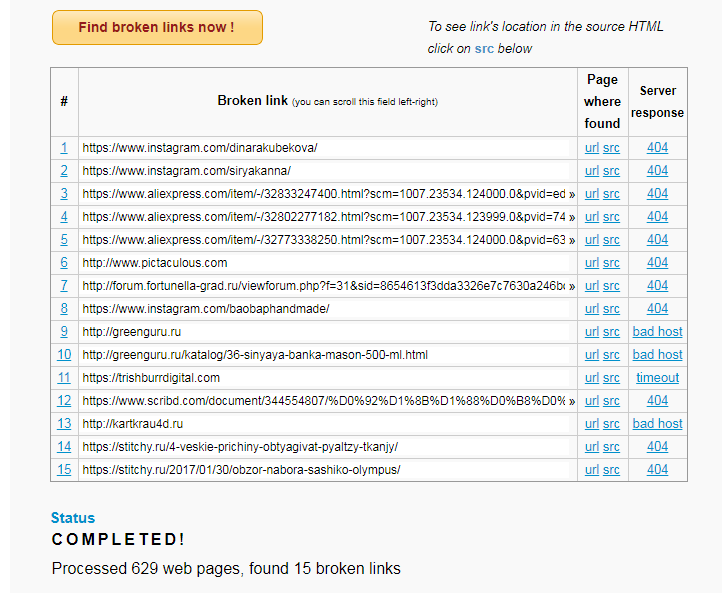

Online Broken Link Checker

Англоязычный онлайн-инструмент для проверки битых ссылок. Бесплатно проверяет до 3000 страниц, смотрит только HTML-документы, то есть ссылок на изображения, видео и другое мультимедиа не будет.

Если вам нужно просканировать больше страниц, проверить подпапки (URL-адреса с /) или отдельные страницы, экспортировать результаты, авторы инструмента предлагают связаться с ними.

Netpeak Spider

Русскоязычная программа для анализа ссылок на сайте. Есть бесплатная версия со всеми функциями, но без возможности копировать, экспортировать и сохранять отчёты.

(Пример анализа сайта программой: netpeak spider ru screen.jpg)

Спайдер анализирует неограниченное количество URL на предмет битых ссылок, картинок, редиректов, а также имеет дополнительные возможности — формирование интерактивных отчётов, интеграции с GA, GSC и Яндекс.Метрика, мульти-доменное сканирование, проверка AMP и разметки и многое другое. Стоит 374,40 долларов в год.

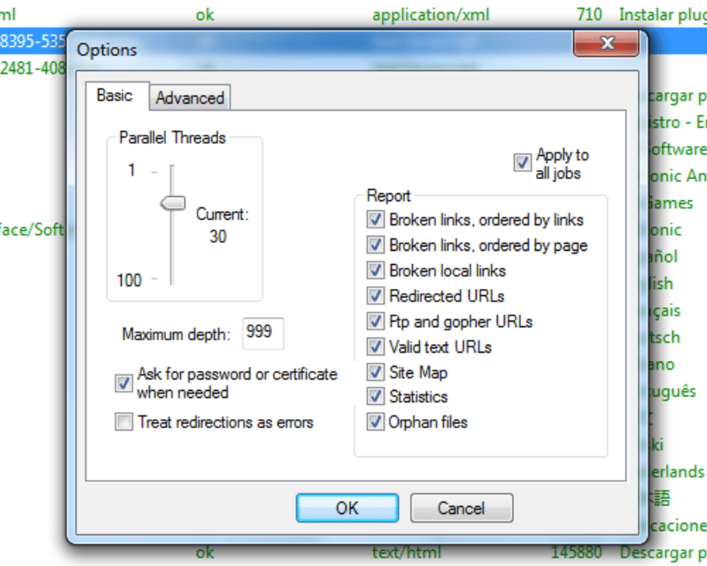

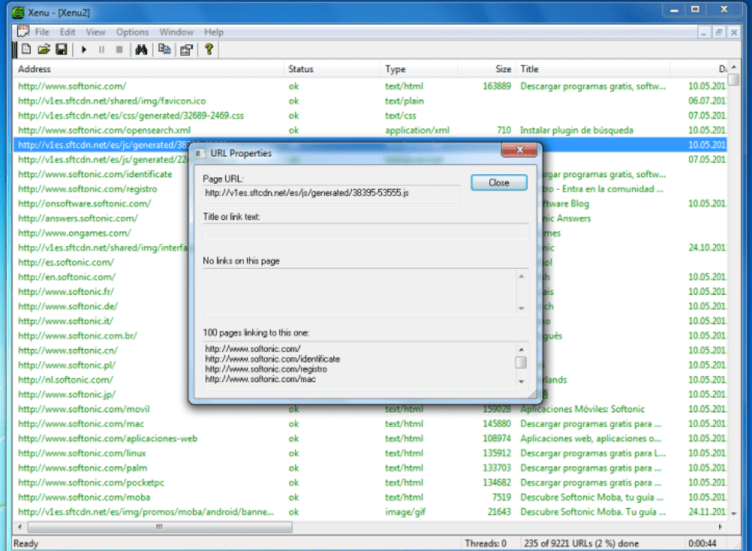

Xenu's Link Sleuth

Бесплатная англоязычная программа для анализа ссылок на сайте. Инструмент захватывает корневую страницу и проверяет ее, переходя на отдельные ссылки для поиска ошибок. Есть настройка работы программы с фильтрами и количеством одновременных потоков проверки.

После завершения проверки Xenu's Link Sleuth генерирует HTML-отчет с результатами.

Работает бесплатно, но проверка больших ресурсов занимает довольно много времени.

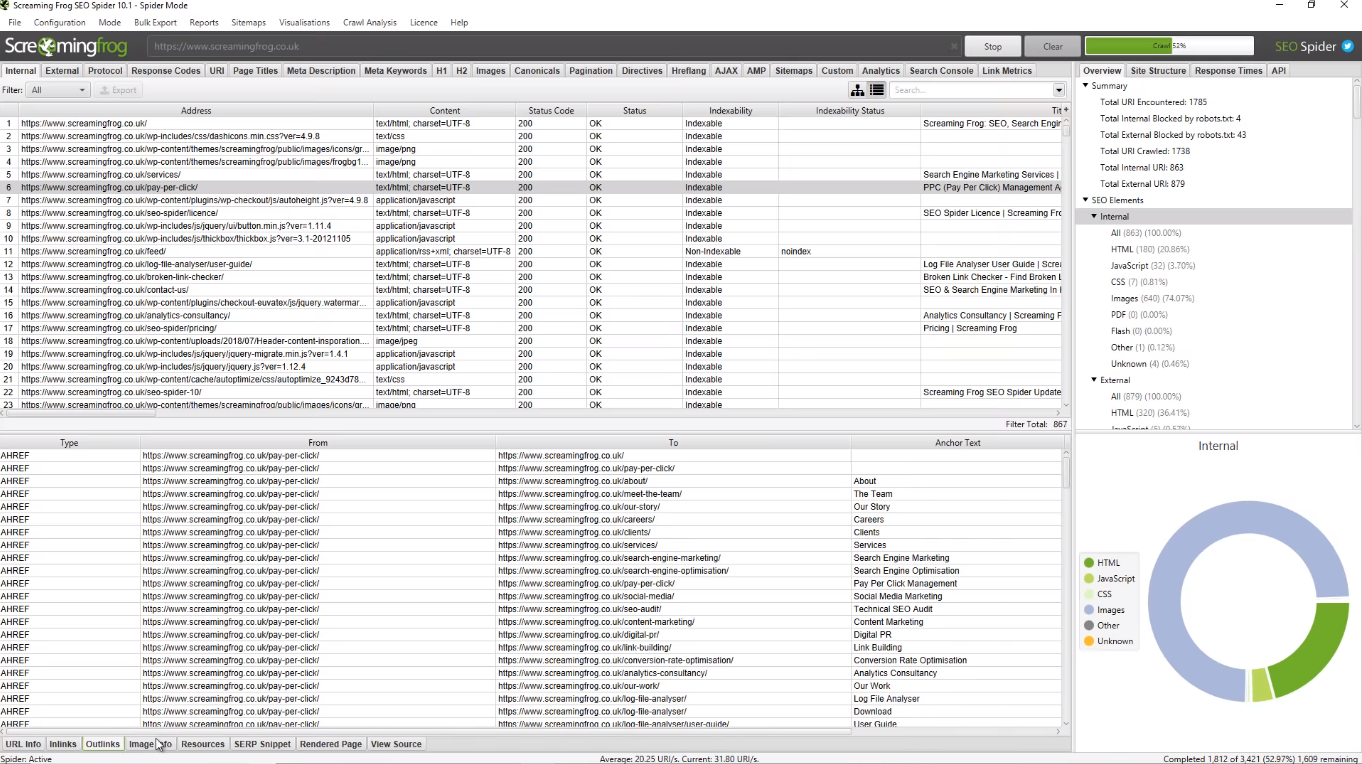

Screaming Frog

Англоязычная программа для анализа ссылок на сайте. Есть бесплатная версия с проверкой 500 страниц.

Платный тариф открывает неограниченное количество страниц для анализа и дополнительные возможности — формирование отчетов, интеграцию с GA, сканирование и проверка AMP и разметки и другие. Стоит 149 евро в год.

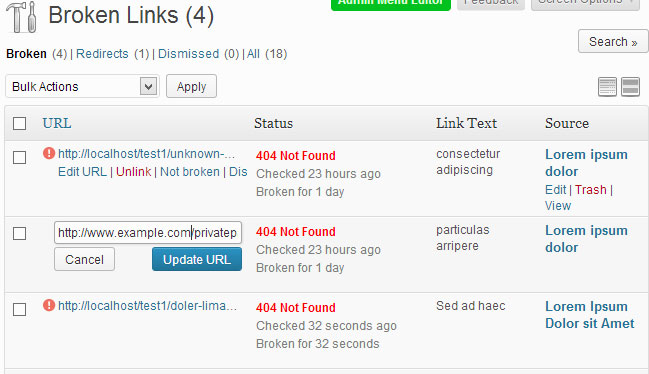

Broken Link Checker, плагин для WordPress

Плагин отслеживает ссылки на страницах сайта — в блоге, комментариях и меню — и оповещает веб-мастера через панель инструментов или по электронной почте о том, что ссылка стала битой. Настройки позволяют работать с этими ссылками — запрещать поисковым ботам переходить по ним, менять и исправлять ссылки внутри плагина, не редактируя сам пост.

Доступен бесплатно, есть русификация.

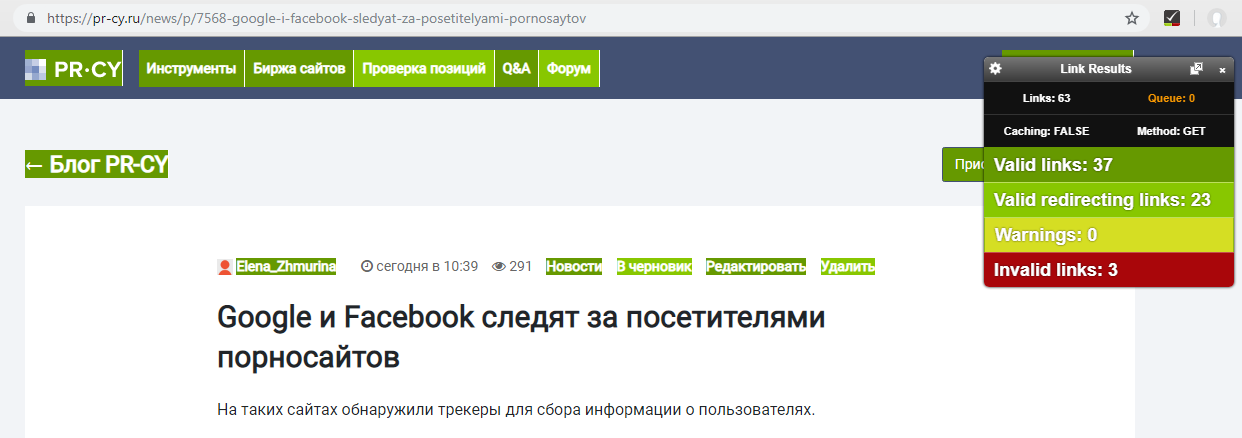

Расширение Check My Links для Google Chrome

Оно подходит для проверки конкретных страниц, позволяет наглядно увидеть местоположение ссылок и их вид.

После установки расширения в браузере в правом верхнем углу появится иконка. Перейдите на нужную страницу, где будете анализировать ссылки, и кликните на иконку. Расширение проверит ссылки, выведет счетчик и подкрасит ссылки цветами. Ссылки, ведущие на страницы 404, будут красными.

Расширение работает бесплатно, но подходит для небольших сайтов или работы с конкретными страницами.

PR-CY

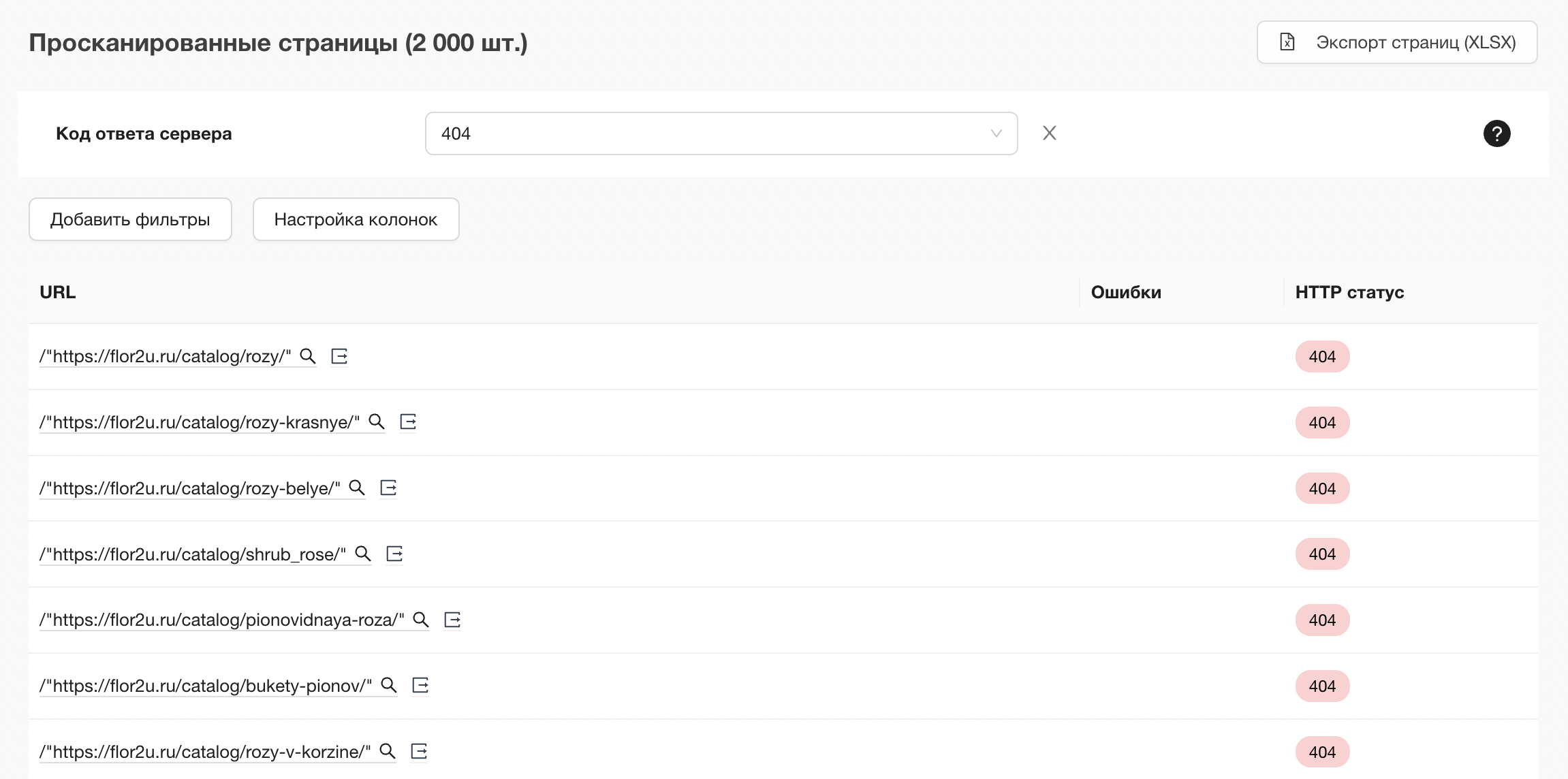

Найти битые ссылки можно с помощью нашего сервиса для анализа сайта. В разделе «Аудит сайта», где сервис показывает результаты проверки внутренних страниц, можно найти все страницы с кодом ответа 404.

Попробовать сервис

FAQ по разделу

Как найти битые ссылки на небольшом сайте?

Можно использовать ручную проверку: пройтись по основным страницам, меню, статьям и карточкам товаров. Также можно посмотреть страницы в выдаче по запросу вида site:домен.ру.

Можно ли найти битые ссылки только через Search Console или Вебмастер?

Можно, но лучше комбинировать несколько способов. Панели вебмастеров показывают данные на основе обхода роботов, а краулеры и плагины помогают найти больше проблем в текущем состоянии сайта.

Какой способ лучше для крупных сайтов?

Лучше использовать специальные краулеры и сервисы аудита. Они позволяют быстро просканировать много страниц, выгрузить отчеты и найти не только 404, но и редиректы, битые изображения и другие ошибки.

Что делать с битыми ссылками и несуществующими страницами

Итак, с помощью сервисов вы нашли ссылки, которые ведут на недоступные страницы. Варианты дальнейших действий зависят от самой ссылки.

Внешняя исходящая ссылка

Ссылка с вашего сайта ведет на другой сайт, но конечная страница не работает. Найдите такие ссылки и удалите, если содержание не пострадает, или замените на актуальные. Если это коммерческая ссылка, которую нельзя удалить и заменить, свяжитесь с партнером и скажите о проблеме с его ресурсом.

На поиске ссылок на страницы 404 на чужих сайтах базируется один из методов получения обратных ссылок. Веб-мастеры отслеживают трафиковые статьи по своей теме, находят в материале нерабочие ссылки, которые ведут другие статьи, и пишут свои посты на эту тему. Потом они обращаются к автору блога и предлагают заменить битую ссылку на их материал. Выигрывают обе стороны: веб-мастер получает ссылку на свой сайт, а автор блога закрывает битую ссылку хорошим материалом и не отправляет пользователей читать несуществующую страницу.

Обратная ссылка

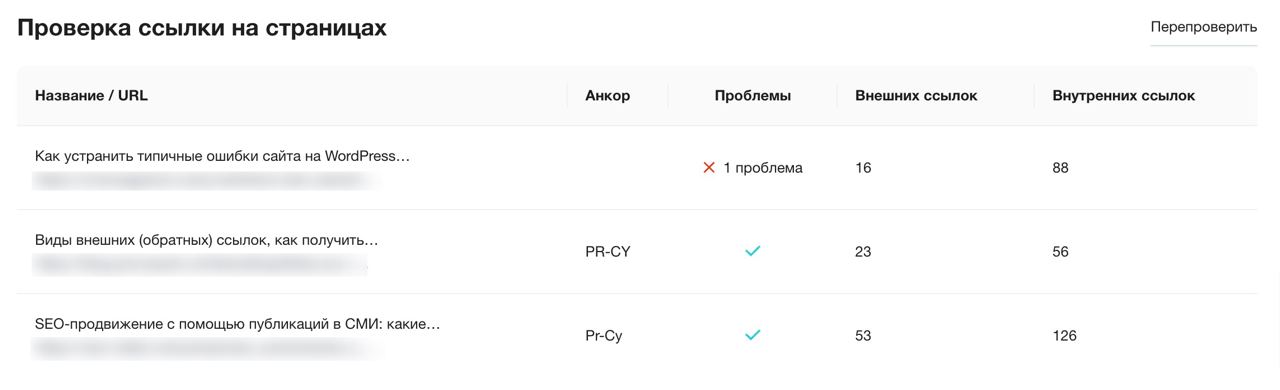

Чтобы проверить, работают ли ссылки, которые вы разместили на других ресурсах, попробуйте наш бесплатный инструмент. Введите адрес целевой страницы и страниц, на которых установлены ссылки. Инструмент покажет анкор, количество внешних и внутренних ссылок на странице-доноре и проблемы со ссылкой, если они есть.

Если ссылка не работает, но страница-донор существует, попросите заменить URL на актуальный. Может быть так, что страницы-донора больше нет. В этом случае напишите владельцу сайта и попросите поставить ссылку с другой, рабочей, страницы.

Внутренняя ссылка

Что делать с битыми ссылками внутри своего сайта:

Если страницу по ссылке удалили случайно, восстановите ее;

Замените битую ссылку в тексте актуальной;

Если существует страница с аналогичным контентом по новому адресу, к примеру, если вы переместили товар в другую категорию с изменением URL, настройте 301 редирект;

Если замены для такой страницы нет, удалите ссылку.

Почитать по теме:

Как удалить устаревший контент из поисковых систем Яндекс и Google

Что делать с недоступными страницами

Даже если вы удалите все ссылки на несуществующие страницы, они все равно будут появляться — пользователь ошибется в адресе, произойдет технический сбой или что-то еще, поэтому рекомендуем сделать настройку.

Страница с ошибкой должна возвращать код ответа 404 (недоступно) или 410 (удалено), но не 220 ОК. Код 410 сервер посылает, если ресурс удален и недоступен, а расположение копии неизвестно. Если документ может быть восстановлен, то лучше передать 404.

Стандартная страница 404 побуждает закрыть вкладку. Настройте свою страницу 404, чтобы возвращать пользователей на сайт и направлять на целевые страницы. Разместите на ней навигацию к работающим разделам сайта, ссылку на главную или что-то смешное и интересное. Это позволит вернуть пользователей к работе с сайтом и оставить хорошее впечатление о компании.

Следующий шаг — разобраться со страницами, которых не существует. Ссылки на них все еще могут быть в индексе ПС, поэтому их нужно удалить.

Как удалить несуществующие страницы из индекса

Удалить страницы из индекса можно через панели веб-мастеров Яндекс и Google.

Чтобы страница удалилась из индекса, сервер при обращении к ней должен возвращать ошибку 404. Если страница существует, но не должна участвовать в поисковой выдаче, закройте ее от индексации правилами robots.txt или мета-тегом noindex.

При следующем обходе сайта роботом запросы на удаление будут выполнены, а страницы исчезнут из результатов поиска.

FAQ по разделу

Что делать с битой внутренней ссылкой?

Нужно выяснить причину: если страницу удалили случайно — восстановить, если URL изменился — поставить 301-редирект, если есть актуальная замена — обновить ссылку, если замены нет — удалить ссылку.

Что делать с битой внешней ссылкой?

Ее лучше заменить на рабочую или удалить, если без нее смысл материала не теряется. Если ссылка важна, можно связаться с владельцем сайта и уточнить актуальный адрес страницы.

Какой код должна отдавать удаленная страница?

Если страница действительно отсутствует, сервер должен возвращать 404 или 410, а не 200 OK. Это помогает поисковым системам правильно понимать статус URL.