Краткое саммари

Kling Motion Control — новый инструмент для создания ИИ-видео. Он не генерирует ролики сам, но позволяет брать за основу уже существующие клипы и переносить движения из видео на фото. Так можно оживлять архивные фото или создавать материалы для бизнеса.

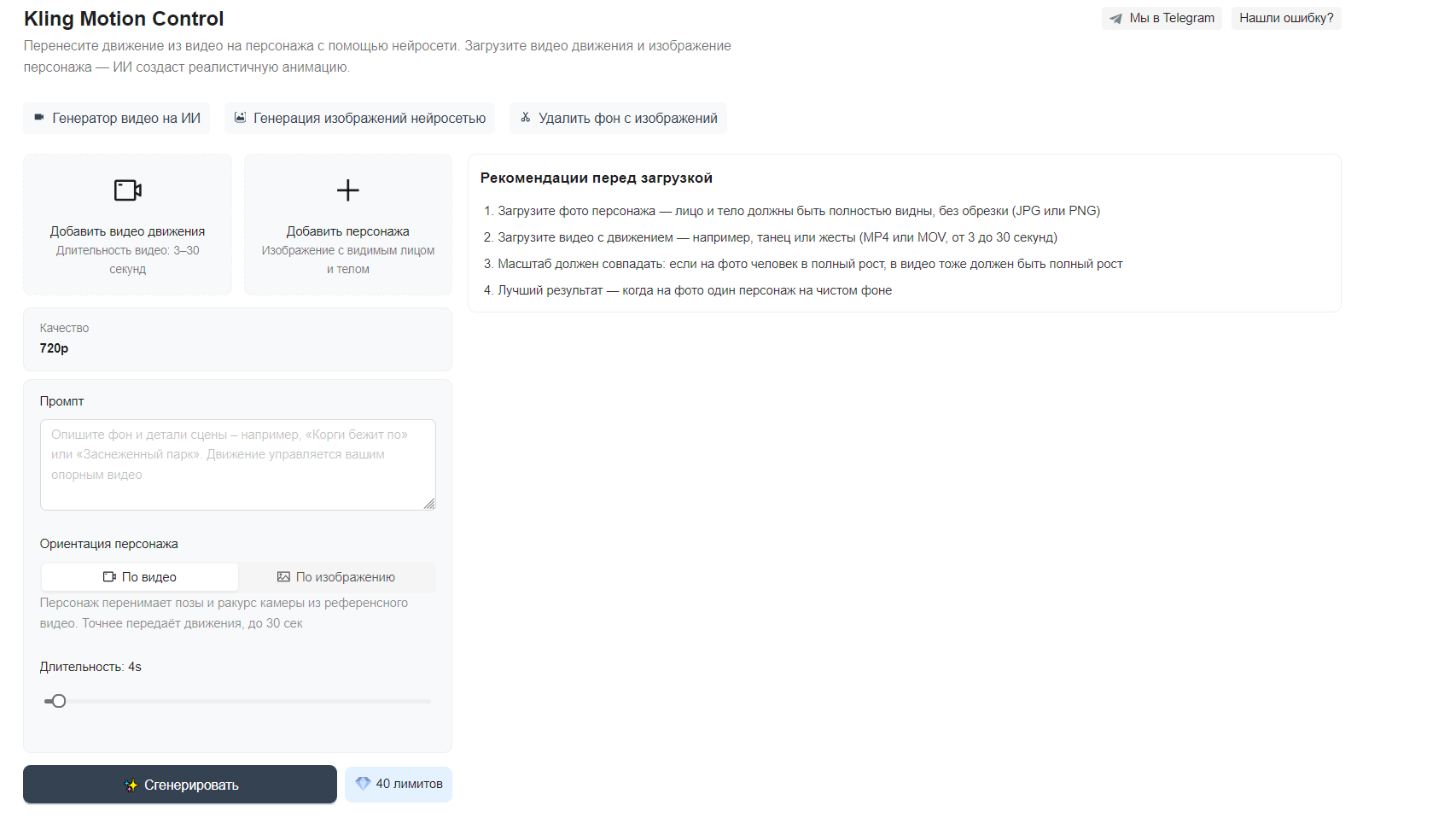

В этой статье описан механизм работы сервиса, главные рекомендации по применению ИИ, а также инструкция, как пользоваться Kling Motion Control в России без сложных операций с картами. Процесс создания видео показан на наглядном примере ролика с танцующей собакой, а каждый этап сопровождается полезными советами.

Кому будет интересна статья:

моушн-дизайнерам,

видеографам,

блогерам,

SMM-специалистам.

Содержание

Среди популярных видеосервисов появился новый заметный инструмент — Kling Motion Control. Его ценят за простой интерфейс и предсказуемый результат, особенно когда нужно анимировать изображение или быстро создать короткий ролик. Разбираемся, в чем секрет этого ИИ, и учимся работать в инструменте за пять простых шагов.

Что это за сервис и чем он отличается от аналогов

Motion Control от Kling появился недавно и сразу стал новым словом в инструментах для генерации видео. В отличие от многих других нейросетей, которые создают видео с нуля, Kling предлагает гораздо больший уровень контроля и реализма благодаря немного иным принципам работы.

За стартовую точку можно взять уже существующий ролик, в котором инструмент распознает движения и создает анимированный «скелет». После этого на готовый каркас накладывается персонаж или объект, добавленный пользователем.

Также ИИ работает с текстовыми промптами, в которых можно указать дополнительные параметры — поведение камеры, уточнения движений, даже изменения фона.

В итоге получается полноценное видео, которое учитывает все ваши пожелания и позволяет контролировать мельчайшие детали — а таким до сих пор не могут похвастаться даже самые продвинутые движки от других разработчиков.

Где пригодится сервис: от оживления фото до создания видео для соцсетей

Главная ценность ИИ от Kling — в том, что производство видео можно поставить на поток и каждый раз получать отличный результат за пару кликов. Главное — использовать качественные исходные материалы.

Механизм модели делает ее очень удобной для повторяющихся задач и быстрой работы с уже существующими форматами. Вот несколько примеров того, где Motion Control сможет себя проявить:

Создание мемов и трендовых видео для соцсетей.

Разработка корпоративного стиля с использованием фирменных персонажей в разных ситуациях.

Продуктовая съемка товаров в динамичных сценариях.

Оживление фотографий с помощью ИИ, в том числе из исторических и семейных архивов.

Создание видео по изображению для рекламы, блогов и презентаций.

Подбор или замена актеров, костюмов и декораций для съемок.

Сравнение нейросетей для видео

Основные конкуренты Motion Control — модели Luma Dream Machine и Runway Gen-3 Alpha Turbo. Хотя уже существует четвертое поколение Runway, именно в третьем реализованы интересные нам функции — работа с уже существующими роликами и гибкое управление камерой.

Разберемся, чем Kling отличается от аналогов и какие преимущества предлагает на их фоне.

Kling Motion Control | Runway Gen-3 Alpha Turbo | Luma Dream Machine | |

Генерация видео на основе другого видео | Есть | Ограниченное (рестайлинг) | Нет |

Управление движением | Автоматическое, на основе исходника | Текстовый промпт | Текстовый промпт |

Управление камерой | Текстовый промпт | Ползунки направления движения и наклона камеры | Выбор движений из заданного списка |

Длина видео | 10-30 секунд | До 10 секунд | До 5 секунд |

Реализм движений | Очень высокий | Высокий | Средний |

Синхронизация губ и речи (липсинк) | Автоматически | Требует дополнительных действий | Нет |

Последовательность генерации | Очень высокая | Высокая | Средняя |

Как работает Kling Motion Control

За работу сервиса отвечает несколько продвинутых алгоритмов, которые берут лучшие из актуальных наработок в области ИИ-видео. Некоторые из них пока можно встретить только у Kling — например, большинство других моделей работают только со статичными источниками и не способны переносить движения.

Алгоритм работы выглядит так:

Motion Control тщательно анализирует исходное видео, выделяет ключевые точки в скелете персонажа и запоминает их изменения.

Модель разбирает анатомию того, что видит на картинке, и ищет точки, которые можно сопоставить с уже известной ей структурой. Например, инструмент распознает положение и взаимосвязь конечностей, отслеживает движения лица.

Motion Control изолирует объект, на который перекладывает модель движения из оригинального видео. Процесс переноса включает в себя в том числе движения губ, глаз и другой мимики. Благодаря этому лицо персонажа сразу синхронизировано с тем, что он произносит в аудиодорожке.

Перед запуском генерации можно указать, что из исходников ИИ должен считать приоритетом. Если выбрать ориентацию по видео, то Motion Control подгонит пропорции персонажа под созданный скелет — это может растянуть конечности и не всегда будет казаться естественным. Ориентация по фото максимально сохраняет внешний вид героя, но некоторые движения могут потеряться, если они покажутся ИИ несовместимыми с анатомией.

Генерация кадров происходит с помощью диффузионных трансформеров (diffusion transformer). Это алгоритм, который позволяет ИИ удерживать внимание одновременно на разных визуальных аспектах, сохраняя последовательность при переходах между кадрами.

Модель просчитывает каждый кадр на основе предыдущего и последующего, стараясь не потерять такие детали, как одежду, лицо или окружение. Текущие версии трансформеров, подобные тому, что использует в Kling, обеспечивают целостность видео даже в ситуациях, когда персонаж отворачивается или выходит из кадра.

Как сделать видео с помощью Kling Motion Control

Kling — зарубежная нейросеть, требующая платного доступа и стабильного подключения. Это может вызвать сложности у некоторых пользователей из России, которые не имеют возможности или не хотят переводить деньги за границу.

Альтернативное решение — инструмент для создания видео на основе Motion Control. Сервис можно оплатить российской картой, поэтому он подойдет тем, кто хочет получить доступ к ИИ без сложных обходных способов.

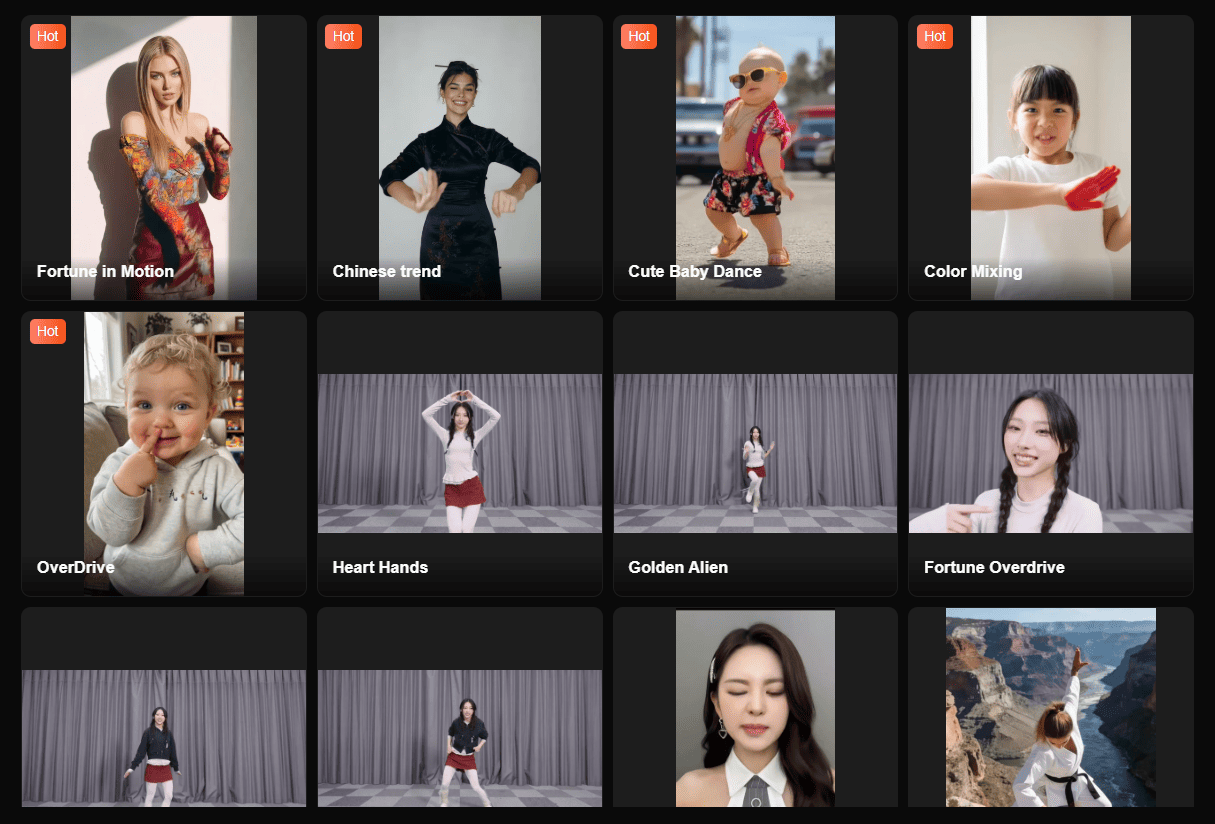

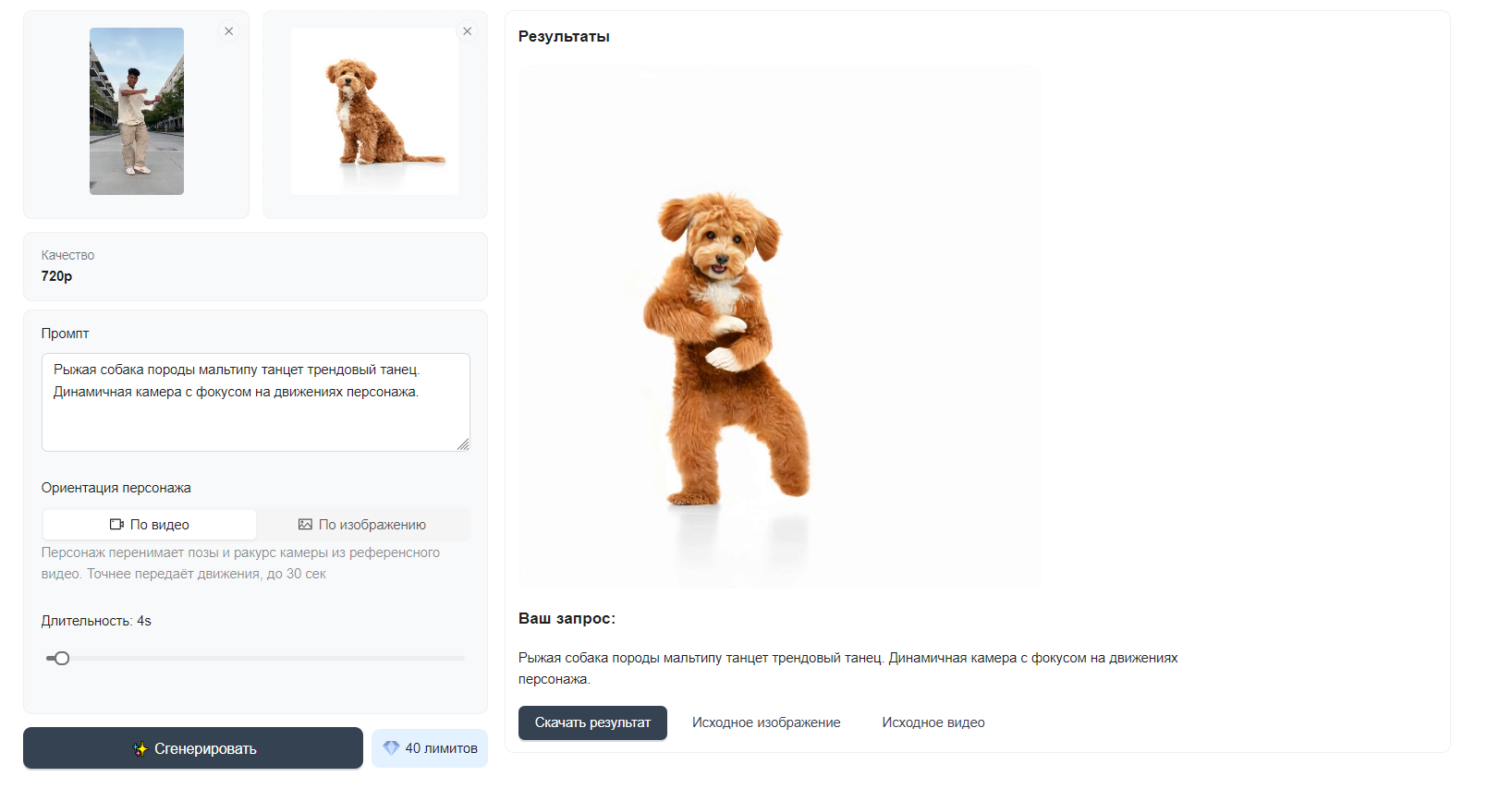

Научимся работать с Motion Control на примере свежего тренда из соцсетей — видео с танцующей собачкой.

Что потребуется перед началом

Для начала работы в Motion Control нужны три элемента:

Исходное видео.

Изображение для оживления.

Текстовый промпт с инструкциями.

Видео служит основой, из которой ИИ извлекает движения и основную динамику камеры. Изображение — пространство, на которое Motion Control перекладывает полученную математическую модель. А с помощью промпта можно уточнить некоторые детали и повлиять на результат.

Пошаговый процесс создания видео в инструменте

Motion Control — достаточно гибкий инструмент, но для идеальных результатов потребуется немного опыта и понимания принципов работы с этим ИИ. Модель лучше всего работает в тех случаях, когда видит объекты полностью и может сопоставить их геометрию, а проработанный промпт позволяет избежать заметных ошибок.

Шаг 1: Подготовьте исходное видео

Оригинальный ролик должен подходить по нескольким параметрам:

Формат MP4 или MOV.

Длительность до 30 секунд

Вес файла — до 10 Мб.

Исходный файл должен быть достаточно легким, иначе инструмент откажется его загружать. Этого можно добиться, сократив длительность или сжав видео до 720p.

Важно: чтобы Motion Control смог составить максимально подробную и точную карту движений, используйте видео людей или объектов в полный рост. Это позволит выделить полноценный скелет со всеми необходимыми точками артикуляции.

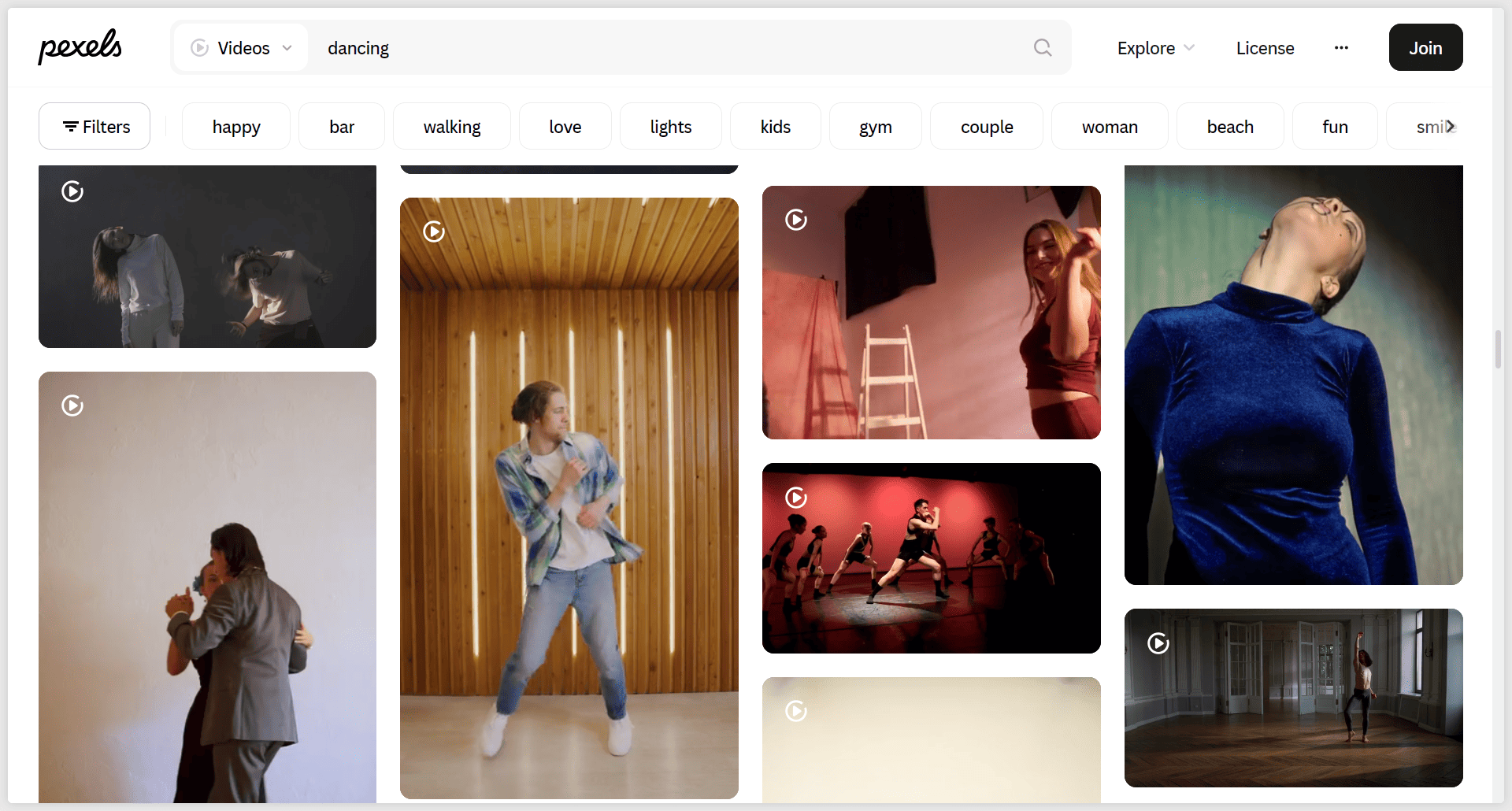

Исходники можно снять самостоятельно или найти на стоковых платформах, где есть целые каталоги видео с поиском по ключевым словам. Если вы собираетесь использовать итоговое видео в коммерческих целях, убедитесь, что у найденных файлов есть соответствующие разрешения. Да и для личного профиля в соцсетях лучше позаботиться о том, чтобы не нарушать ничьи авторские права. Бесплатные видеостоки с открытой лицензией можно найти на таких сайтах, как Pexels, Freepik и Mixkit.

Почитать по теме:

Топ-10 бесплатных фотостоков 2026: фото для сайта легально

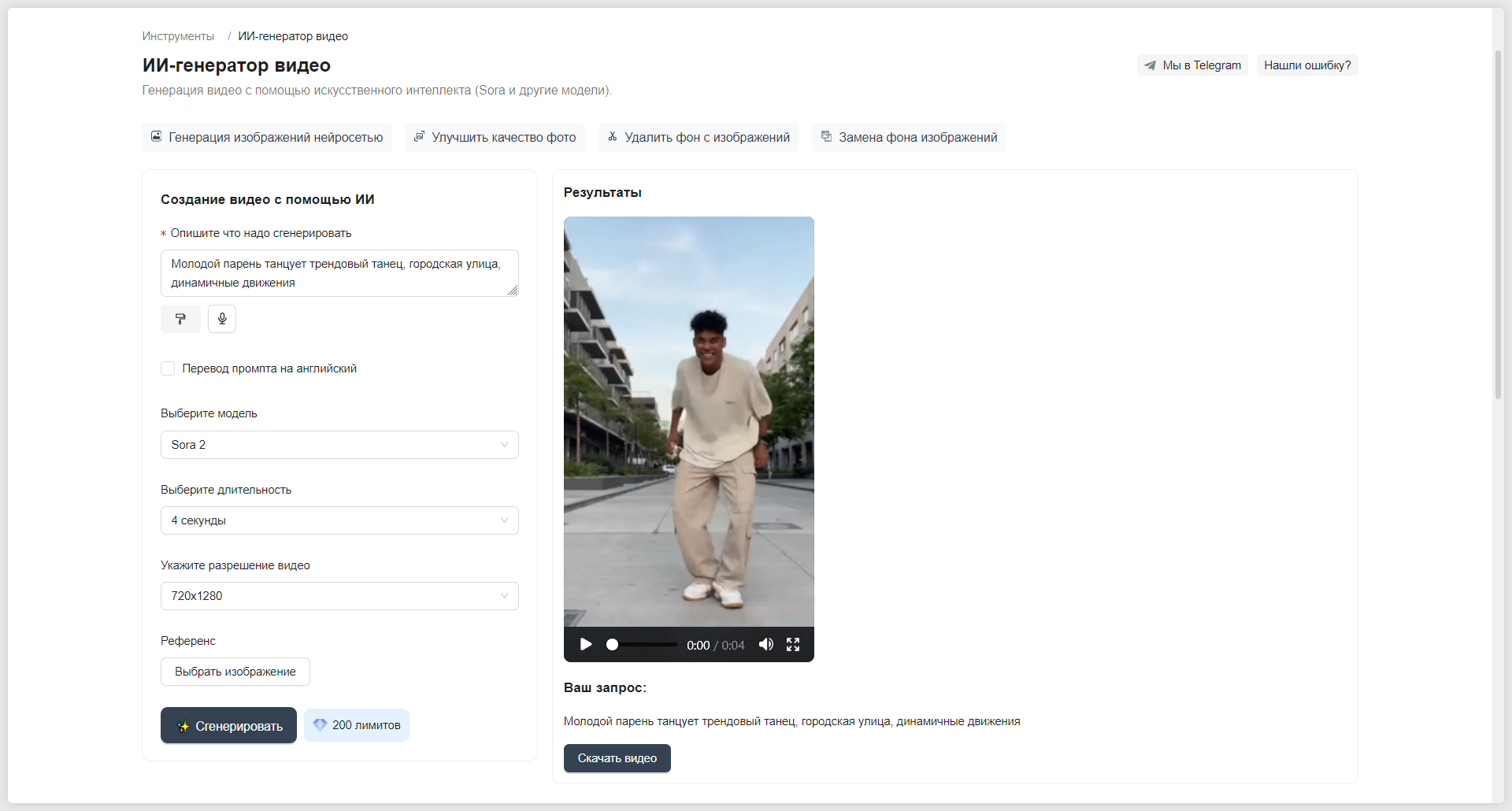

Еще один вариант — сгенерировать видео для референса. Такой способ позволяет получить исходник, отвечающий вашим требованиям и уже максимально близкий к нужному результату. Motion Control в связке с другим ИИ для генерации видео составляет мощную пару — вы создаете подходящий вам ролик и используете его как шаблон для других.

Воспользуемся ИИ-генератором видео, чтобы создать свой оригинальный ролик. Ссылка на нужную страницу расположена в интерфейсе Motion Control: это позволяет быстро переходить между инструментами.

Подготовим исходник с помощью простого промпта. Нам нужно видео с динамичным танцем на естественном фоне — опишем это в инструкции и зададим нужные параметры видео, включая разрешение и длительность.

Исходник готов. Чтобы сохранить ролик на устройство, кликните на нем правой кнопкой и нажмите «Сохранить видео».

Если Motion Control не принимает видео, проверьте, соответствует ли оно требованиям по весу, длительности и разрешению файла. В любом редакторе можно поменять формат видео, обрезать ненужные куски и задать настройки качества. Для этого подойдут даже самые простые онлайн-инструменты вроде Canva или Microsoft Clipchamp.

Шаг 2: Подберите изображение

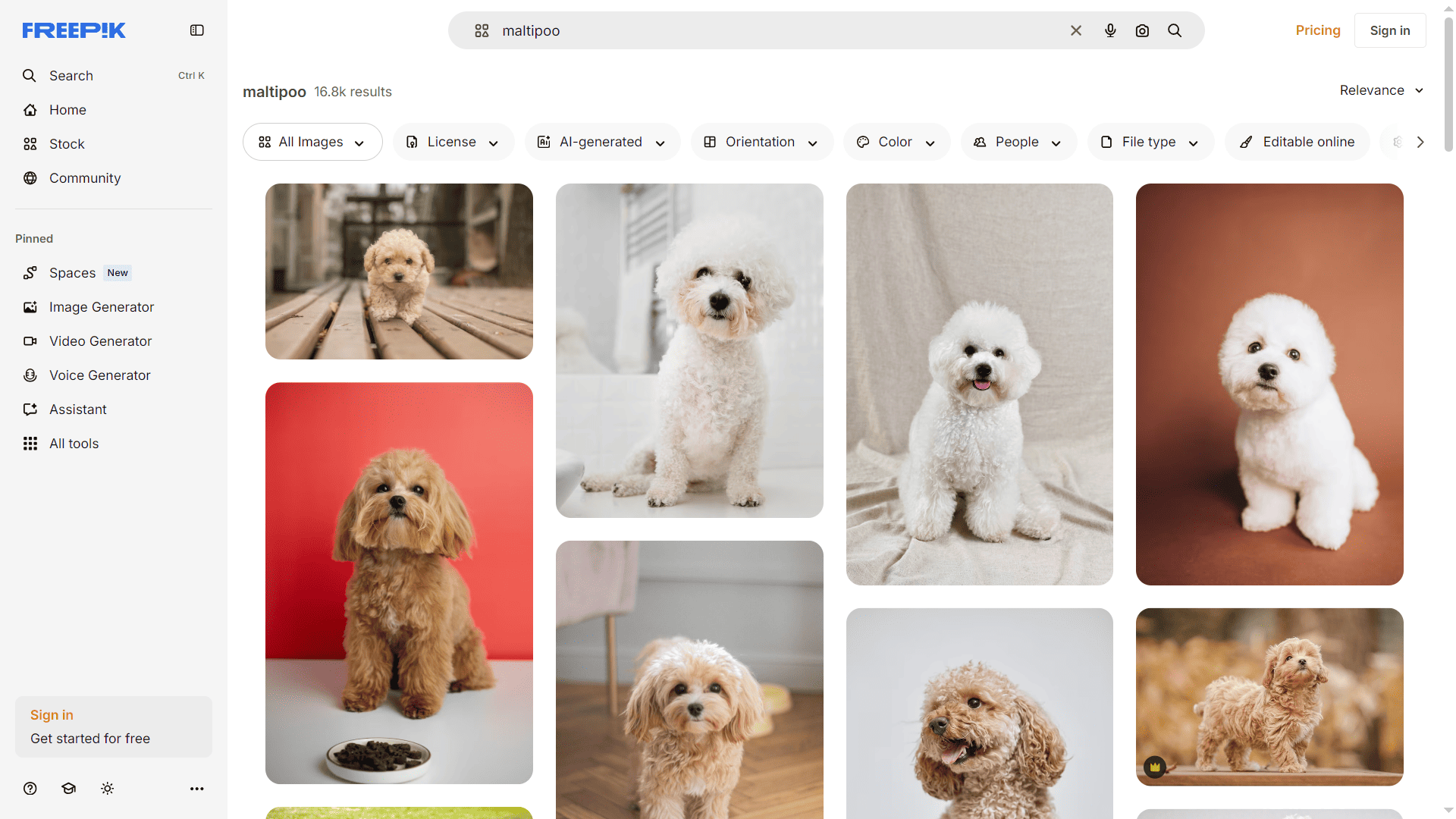

Для картинок действует тот же основной принцип — лучше всего подобрать изображение в полный рост. Это особенно важно, если вы хотите анимировать изображение без искажений в анатомии и движениях. Файлы должны быть в формате JPG или PNG — чем выше качество, тем лучше.

Фотографии для оживления можно взять из личных архивов или поискать на всё тех же стоках. Не забудьте проверить, разрешает ли автор изображения его свободное использование. Особенно это касается известных персонажей, на которые распространяются еще и права на интеллектуальную собственность.

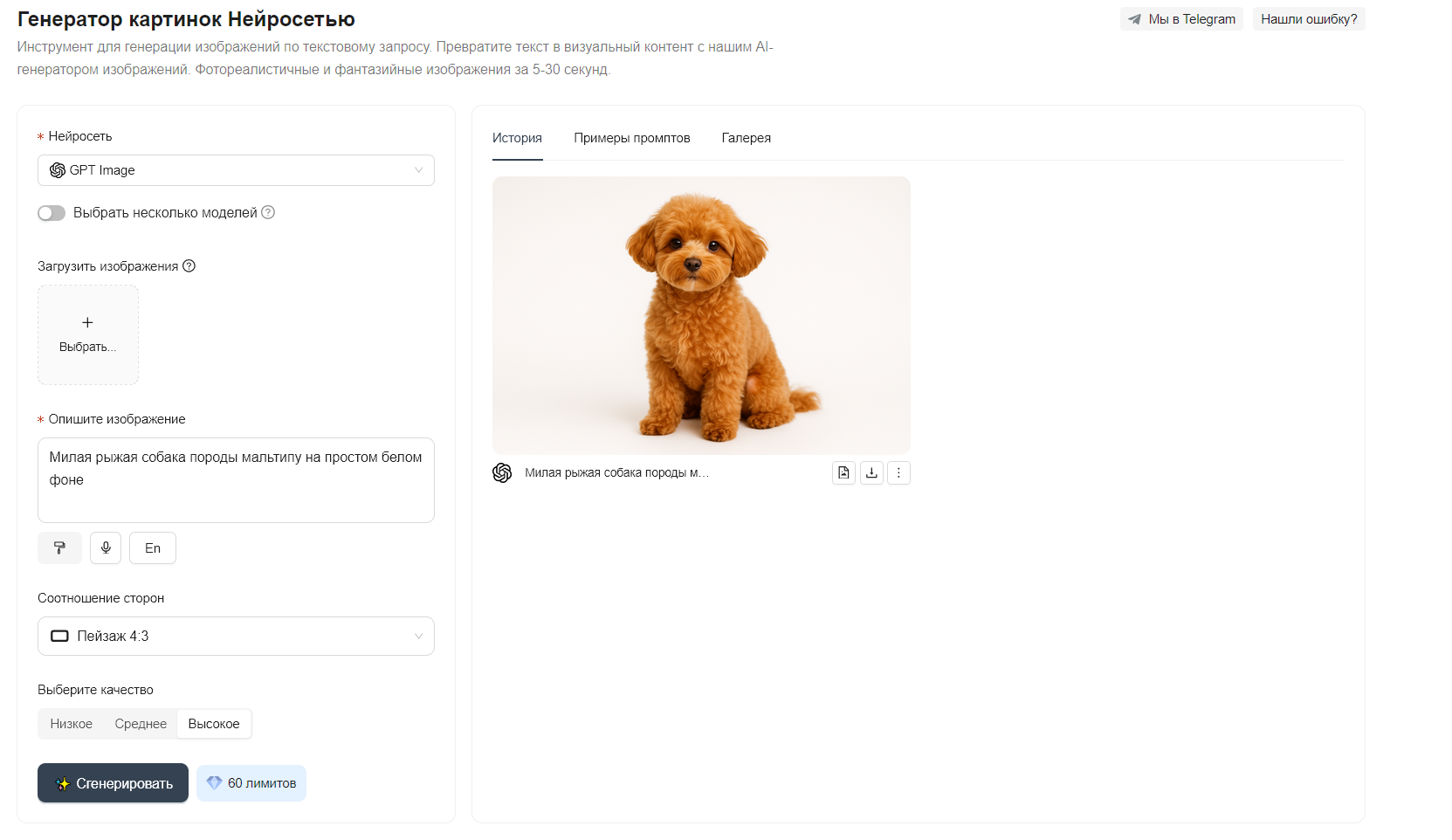

Изображение тоже можно создать самостоятельно:

Откройте инструмент «Генерация изображений нейросетью», ссылка на который тоже есть в интерфейсе Motion Control.

Выберите модель ИИ, соотношение сторон и качество.

Опишите нужное вам содержимое и нажмите «Сгенерировать».

Откройте готовую картинку, кликните правой кнопкой мыши и нажмите «Сохранить изображение», чтобы скачать его на устройство.

Если вы не можете найти подходящую картинку, ее всегда можно создать с помощью ИИ.

Почитать по теме:

Nano Banana: что умеет новый генератор изображений от Google и как им пользоваться

Шаг 3: Напишите промпт для Kling Motion Control

Составьте описание, которое передаст вашу задумку с учетом выбранных параметров и возможностей инструмента. На этом этапе можно уточнить детали исходников — кто на изображении, что именно должно происходить.

Учтите, что поменять характер действий не получится — Motion Control опирается на то, что имеет, и стремится быть максимально близким к источнику. Через промпт не выйдет заменить танец на полет — для этого придется подобрать другой исходник.

Зато с помощью промпта можно повлиять на поведение камеры. Это очень важно — без указаний по съемке ИИ может взять дело в свои руки, а это не всегда дает хорошие результаты. С помощью текста можно задать движения камеры — добавить динамики, наклон или следование за персонажем. Если вам нужен стандартный статичный кадр, это тоже лучше указать словами.

Еще через промпт можно изменить фон. Так как в процессе работы сервис отделяет персонажа от остальной картинки, можно попробовать заменить окружение. Это полезно, когда ваш объект расположен на абсолютно пустом однотонном фоне, а вы хотите добавить видео глубины.

Шаг 4: Выберите ориентацию и длительность

От ориентации персонажа зависит то, как Motion Control будет совмещать карту движений из видео с анатомией объекта на фото. В нашем примере мы хотим, чтобы собака повторяла человеческий танец — это может создать некоторые сложности.

Чтобы точно перенести движения танцора при ориентации на видео, ИИ нужно «очеловечить» собаку. Из-за этого могут появиться неестественные искажения — например, слишком длинные лапы и нехарактерные для собак изгибы. Но в нашем случае мы не стремимся к реализму, поэтому на такие детали можно не обращать внимания.

При ориентации на фото Motion Control постарается сохранить реалистичное поведение, заставляя собачку танцевать так, как это делало бы настоящее животное. Но здесь нарушается последовательность анимации — не все точки совмещаются между собой, движения могут стать слишком дергаными, а в некоторых кадрах у собаки может вырасти пятая нога или второй хвост.

Другой технический параметр, который можно выбрать — длительность. Модель поддерживает до 10 секунд при ориентации на фото и до 30 секунд по видео. Здесь все зависит от длительности исходника — если движения равномерны на протяжении всего ролика, то получится хорошо сгенерировать и длинное видео. Но лучше всего ИИ себя проявляет в коротких роликах — стандартным значением считается 4-5 секунд. За такой отрезок времени не успевают появиться ошибки и артефакты, которые иногда выдают нейросети.

Шаг 5: Сгенерируйте видео и оцените результат

Проверим, что все готово: мы добавили исходники фото и видео, написали промпт, задали ориентацию и длительность. Теперь видео готово к обработке. Нажмите «Сгенерировать» и подождите — процесс может занять от нескольких секунд до пары минут.

Для примера мы выбрали фотографию собаки породы мальтипу на белом фоне. Это позволяет инструменту детально разглядеть персонажа и качественно отделить его от окружающих пикселей. Но так видео получается скучноватым.

Попробуем немного изменить промпт, добавив пару деталей из оригинального ролика — пусть собака танцует на фоне городской улицы, а на заднем фоне будут видны деревья и дома.

После генерации всегда стоит оценить результат. Проверьте, насколько видео совпадает с вашим замыслом, нет ли в нем очевидных ошибок, нарушений логики и последовательности анимации. Недочеты можно исправить, если изменить промпт или попробовать другой исходник.

Как писать промпты для генерации видео

Свою основную работу Motion Control делает, опираясь на загруженные в него файлы. Тем не менее, хороший текстовый промпт гарантирует, что ИИ правильно поймет и то, что происходит на видео, и то, что вы хотите от него получить.

Делайте упор на визуале, а не на действиях. Важно описать, что вы хотите видеть в результате — детали персонажа и его окружения, общее настроение и другие параметры. Motion Control в любом случае увидит и обработает движения, но вы можете уточнить их для большей уверенности в результате.

Думайте как режиссер. В промпте можно прописать настройки камеры, выставить освещение и поправить качество картинки. Подробно объясните, как должен выглядеть кадр и на что нейросети нужно обратить особое внимание.

Используйте понятный язык. В своих ответах ИИ может изъясняться витиевато, но сами нейросети плохо дружат с расплывчатыми инструкциями и поэтическими описаниями — результат может быть непредсказуемым. Научитесь говорить на языке модели — «мягкий кинематографичный свет», «качество 4К», «проработанная текстура волос». Так инструменту будет проще сопоставить запрос с известным ему массивом данных и понять, что вы от него хотите.

В некоторых случаях можно посоветовать перевести промпт на английский. Хотя почти все ИИ научились работать с локализацией, иногда словарного запаса все-таки не хватает. Тогда ваши инструкции могут потеряться из-за незнакомых слов или случайных опечаток. Если инструмент настойчиво игнорирует некоторые команды, попробуйте повторить их на английском или полностью перевести текст.

Готовые промпты для Kling Motion Control

Предлагаем несколько готовых промптов, которые можно попробовать для разных сценариев — от чисто креативных до коммерческих работ.

Пример 1. Футуристичный танец

Исходное видео: танец под электронную музыку.

Исходное фото: девушка с яркой прической и одеждой в уличном стиле.

Промпт: Кинематографичный план в полный рост: девушка с неоновыми волосами, одежда в стиле киберпанк. На фоне ночной Токио с эффектом боке. Разрешение 8K, фотореализм, четкие детали, плавная физика ткани, танцевальные движения из видео. Динамичная камера, следующая за движениями персонажа.

Пример 2. Оживление фото

Исходное видео: крупный план лица с нейтральной естественной мимикой.

Исходное фото: архивная фотография человека на фоне деревни.

Промпт: Старое черно-белое фото деревенского жителя. Текстура пожелтевшей потертой бумаги. На фоне — изба и сельская дорога с мягким размытием вне фокуса. Эффект съемки в стиле ретро хроники. Выражение лица и движения повторяют видео. Статичный кадр, персонаж находится в центре.

Пример 3. Съемка продукта

Исходное видео: подставка с объектом-пустышкой на месте продукта.

Исходное фото: фотография флакона духов из каталога.

Промпт: Рекламная съемка флакона элитного парфюма на вращающейся стеклянной поверхности. Капли воды на стекле, элегантное золотистое освещение, мягкие тени. Премиальная эстетика, дорогая студийная съемка. Движения камеры повторяют видео.

Пример 4. Создание сцены для фильма в жанре фэнтези

Исходное видео: персонаж, идущий в кадре справа налево.

Исходное фото: девушка в образе эльфа на фоне леса.

Промпт: Принцесса эльфов идет по солнечному лесу. Атмосфера фэнтези 80-х, теплая цветовая гамма. Мягкий свет пробивается сквозь листья. Детально проработанные текстуры волос и украшений. Съемка в 4К, камера приближается к персонажу.

💌 Еженедельная рассылка

Подпишитесь на нашу рассылку — раз в неделю будем отправлять на ваш email свежую статью из блога и другие полезные материалы.

Типичные ошибки генерации видео и как их не допускать

Как и у любой другой нейросети, у ИИ от Kling есть свои ограничения. Если их игнорировать, вы получите видео, далекое от результата. Чтобы избежать серьезных ошибок и лишних затрат, стоит понимать, чего в Motion Control лучше не делать.

Ошибка 1: Слишком много действий

Motion Control создает анимированную модель на основе четких движений персонажей. Если в видео будет толпа людей, а каждый из них будет одновременно бегать, прыгать и махать руками, получится неразборчивая каша. Такой результат не получится перенести на изображение, и в итоге вы, скорее всего, увидите полный хаос.

В идеале у вас должен быть один герой, движения которого и будет считывать нейросеть. Лучше всего, если он совершает одно действие или хотя бы их четкую последовательность. Резкие переходы могут плохо повлиять на математическую модель. Если вам нужно, чтобы в видео было много персонажей, которые делают разные вещи, советуем сгенерировать разные кадры с ними, а потом объединить их в один ролик.

Ошибка 2: Неподходящие исходники

Главные проблемы часто оказываются в исходниках. Чтобы перенос движений произошел полноценно, нужно подобрать видео и картинку примерно похожего вида — например, оба персонажа стоят в полный рост или одинаково сняты крупным планом. Секрет в том, чтобы скелет анимации хорошо ложился на анатомию финального объекта — иначе движения рискуют стать непредсказуемыми.

Здесь мы наложили анимацию из того же видео на фотографию собаки крупным планом — мальтипушка танцует, но большинство движений остается за кадром.

Ошибка 3: Недоработанный промпт

Простое видео в паре с четким исходным изображением не всегда нужно дополнять подробным промптом. Но если вам нужно создать видео, достойное представлять ваш бизнес или творческие начинания, поработать над текстом все же придется.

Без четких инструкций нейросети начинают вносить отсебятину. В случае с Motion Control могут появиться ненужные движения камерой или, наоборот, съемка будет выглядеть слишком безжизненной. Без промпта не получится сфокусироваться на мелких деталях, изменить фон и задать нужное ощущение.

Ошибка 4: Перебор с эмоциями

Важно, чтобы совпадала не только анатомия, но и выражения лиц. Нейросети будет сложно передать мимику героя видео, если на картинке персонаж уже улыбается во все лицо. Для начального изображения рекомендуем использовать фотографии с нейтральными эмоциями — это хорошая стартовая точка для любых изменений. Все действия с губами, глазами и поворотами головы лучше доверить исходному видео.

FAQ по работе с Motion Control

Какие исходники нужны для анимации фото?

Фигуры героев фото и видео должны быть видны в полный рост или сняты в одном плане — например, в портретной съемке. Движения должны быть хорошо видны, а анатомия персонажей — максимально совпадать.

Где искать видео для генерации?

Чтобы избежать проблем с авторскими правами, исходники стоит делать самостоятельно или искать в библиотеках бесплатного видео. Также их можно сгенерировать в другой нейросети.

Почему ролик не загружается?

Возможно, не подходят технические параметры видео. Убедитесь, что вы загружаете файл в формате MOV или MP4, его вес не превышает 10 мегабайт, а длительность — 30 секунд. Изменить видео можно в любом онлайн-редакторе.

Чем отличаются ориентация на видео и ориентация на фото?

Ориентация на видео делает фокус на карте движений и накладывает персонажа с фото на анимационный скелет. Ориентация на фото адаптирует движения к анатомии героя на изображении. Один подход может быть эффективнее другого в зависимости от того, какой результат вам нужен.

Чем Kling Motion Control отличается от других нейросетей для видео?

Motion Control не генерирует ролики с нуля, а использует уже готовое видео для оживления изображений. Это гарантирует плавность движений, последовательность генерации и естественность персонажей и объектов.

Зачем нужен промпт в Motion Control?

С помощью промпта можно повлиять на выдачу инструмента — уточнить детали, описать требуемый визуальный стиль, добавить фон и другие элементы видео.

Где можно использовать видео, созданное нейросетью по фото?

Видео, созданные с помощью сервиса, подойдут для использования в соцсетях, в рекламе вашего бизнеса или в творческих проектах — все зависит от вашего воображения, качества исходников и готовности потрудиться над промптом.