Компания выложила исходный код своей нейросети сразу на GitHub. Одна из самых закрытых организаций в мире пошла на такой шаг, чтобы закрепить место лидера в сфере LLM и начать конкурировать с Microsoft и Google, которые имеют гораздо больше вычислительных ресурсов, считают специалисты.

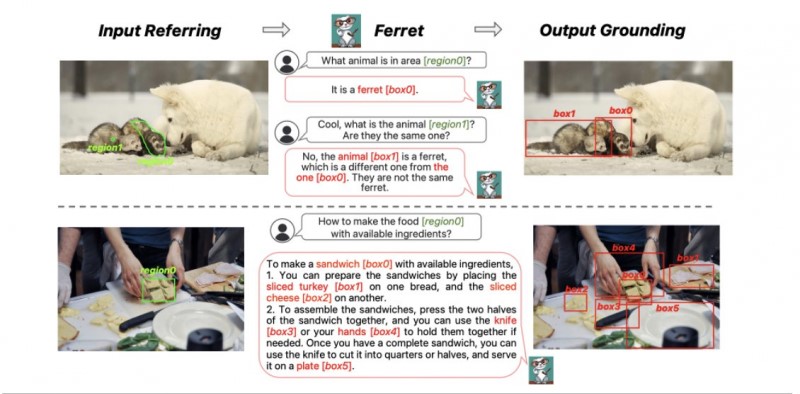

Ferret умеет взаимодействовать с изображениями. Например, если пользователь выделит на картинке животное и спросит LLM, что это, нейросеть назовет его и ответит, к какому виду оно относится. Чем больше элементов выделит пользователь, тем больше контекста он получит для ответов. Например, чем животное занимается, где оно находится и какие у него есть особенности.

О перспективах проекта сказать пока трудно, ведь по словам технического блоггера Бена Диксона, мощности инфраструктуры Apple недостаточно для обслуживания LLM такого масштаба, поэтому компании пришлось принять решение выпустить проект в открытом формате.